La inteligencia artificial física plantea interrogantes sobre la gobernanza de los sistemas autónomos, un tema que cobra cada vez más relevancia a medida que estos sistemas se integran en robots, sensores y equipos industriales.

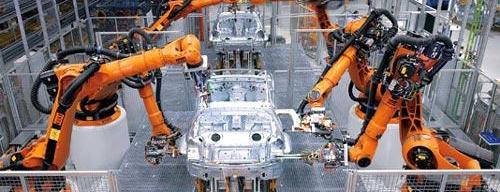

No se trata únicamente de si los agentes de IA pueden llevar a cabo tareas, sino de cómo se evalúan, monitorean y detienen sus acciones cuando interactúan con sistemas del mundo real. La robótica industrial ya ofrece una base considerable para abordar esta discusión.

Según la Federación Internacional de Robótica, en 2024 se instalaron 542,000 robots industriales en todo el mundo, más del doble de lo que se registró anualmente hace una década. Se prevé que las instalaciones alcancen 575,000 unidades en 2025 y superen las 700,000 unidades para 2028.

Los investigadores de mercado también aplican la etiqueta de IA física a un grupo más amplio de sistemas, que incluye robótica, computación en el borde y máquinas autónomas. Un estudio de Grand View Research estima que el mercado global de IA física alcanzará los 81.64 mil millones de dólares en 2025 y podría llegar a 960.38 mil millones de dólares para 2033, aunque esta categoría depende de cómo los proveedores definan la inteligencia en los sistemas físicos.

El desafío de gobernanza en este ámbito es distinto al de la automatización únicamente basada en software, ya que los sistemas físicos pueden operar en entornos laborales, infraestructura y en interacción con usuarios humanos. Además, pueden estar conectados a equipos que requieren límites de seguridad claros. La salida de un modelo puede traducirse en un movimiento robótico o en una instrucción para una máquina, así como en una decisión basada en datos de sensores. Esto convierte los límites de seguridad y las rutas de escalación en partes esenciales del diseño del sistema.

Un ejemplo reciente de cómo se están adaptando los modelos de IA para este entorno es el trabajo de Google DeepMind en robótica. En marzo de 2025, la compañía presentó Gemini Robotics y Gemini Robotics-ER, modelos construidos sobre Gemini 2.0 para robótica y IA encarnada. Gemini Robotics es un modelo de visión-lenguaje-acción diseñado para controlar robots directamente, mientras que Gemini Robotics-ER se centra en el razonamiento encarnado, que incluye la comprensión espacial y la planificación de tareas.

Un robot que utilice este tipo de modelo debe ser capaz de identificar un objeto, comprender una instrucción y planificar una secuencia de movimientos. También necesita evaluar si la tarea se completó correctamente, lo que genera un problema de control que abarca tanto el comportamiento del modelo como los límites mecánicos del sistema. Google DeepMind afirma que los robots útiles requieren generalidad, interactividad y destreza. La generalidad abarca objetos y entornos desconocidos, la interactividad se relaciona con la entrada humana y las condiciones cambiantes, y la destreza se refiere a tareas físicas que requieren movimientos precisos.

En sus materiales de lanzamiento, Google DeepMind indicó que Gemini Robotics podría seguir instrucciones en lenguaje natural y realizar tareas de manipulación en múltiples pasos. Entre los ejemplos se incluyen doblar papel, empacar artículos en una bolsa y manejar objetos no vistos durante el entrenamiento. Los requisitos técnicos para la IA física son más amplios que la comprensión del lenguaje. Los sistemas necesitan percepción visual y razonamiento espacial, así como planificación de tareas y detección de éxito.

En robótica, la detección de éxito es crucial porque el sistema debe decidir si una tarea se ha completado, si debe intentarlo de nuevo o si debe detenerse. Gemini Robotics-ER 1.6, presentado en abril de 2026, demuestra cómo estas funciones se están empaquetando en modelos más nuevos. La compañía describe este modelo como capaz de soportar lógica espacial, planificación de tareas y detección de éxito, con la habilidad de razonar sobre pasos intermedios y decidir si avanzar o intentar de nuevo.

La documentación de desarrollo de Google menciona que Gemini Robotics-ER 1.6 está disponible en vista previa a través de la API de Gemini. Esta documentación lo describe como un modelo de visión-lenguaje que lleva las capacidades agentivas de Gemini a la robótica, incluyendo interpretación visual, razonamiento espacial y planificación a partir de comandos en lenguaje natural. Google AI Studio proporciona un entorno de desarrollo para trabajar con modelos Gemini, mientras que la API de Gemini ofrece una vía para integrar estos modelos en aplicaciones.

En el contexto de la IA encarnada, esto acerca las pruebas y los estímulos a los desarrolladores que crean aplicaciones agentivas. La gobernanza se complica aún más cuando estos sistemas pueden invocar herramientas, generar código o desencadenar acciones. Es necesario definir qué datos puede acceder el sistema, qué herramientas puede utilizar, qué acciones requieren aprobación humana y cómo se registran las actividades para su revisión.

La investigación sobre confianza en IA de McKinsey en 2026 señala un problema similar en la IA empresarial en general. Solo alrededor de un tercio de las organizaciones reportaron niveles de madurez de tres o más en estrategia, gobernanza y gobernanza de IA agentiva, a pesar de que los sistemas de IA asumen funciones cada vez más autónomas.

En robótica, la seguridad también incluye el comportamiento físico de la máquina. Google DeepMind describe la seguridad robótica como un problema estratificado, que abarca controles de bajo nivel como la evitación de colisiones, límites de fuerza y estabilidad, así como razonamientos de alto nivel sobre si una acción solicitada es segura en un contexto determinado. La compañía también introdujo ASIMOV, un conjunto de datos para evaluar la seguridad semántica en robótica y IA encarnada, diseñado para probar si los sistemas pueden entender instrucciones relacionadas con la seguridad y evitar comportamientos inseguros en entornos físicos.

Los mismos controles que se utilizan para agentes de software se vuelven más difíciles de gestionar cuando los sistemas están conectados a robots, sensores o equipos industriales. Estos incluyen derechos de acceso, auditorías y comportamiento de rechazo, así como rutas de escalación y pruebas. Marcos de gobernanza como el Marco de Gestión de Riesgos de IA del NIST y la ISO/IEC 42001 proporcionan estructuras para gestionar riesgos y responsabilidades de IA a lo largo del ciclo de vida del sistema. En la IA física, esos controles deben considerar el comportamiento del modelo, las máquinas conectadas y el entorno operativo.

Google DeepMind también ha colaborado con empresas de robótica como parte de su desarrollo de IA encarnada. En marzo de 2025, la compañía anunció su asociación con Apptronik en robots humanoides utilizando Gemini 2.0, y mencionó a Agile Robots, Agility Robotics, Boston Dynamics y Enchanted Tools como probadores de confianza para Gemini Robotics-ER.

La actualización de 2026 también hizo referencia a trabajos con Boston Dynamics en tareas robóticas como la lectura de instrumentos, un tipo de caso de uso que depende de la comprensión visual, la planificación de tareas y la evaluación confiable de las condiciones físicas. La IA física se aplica a la inspección industrial, la fabricación y la logística.