Durante la conferencia Google Cloud Next, Google y NVIDIA presentaron su hoja de ruta de hardware, orientada a reducir drásticamente los costos de inferencia de inteligencia artificial a gran escala. Las compañías anunciaron los nuevos instancias bare-metal A5X, que operan sobre los sistemas de rack NVIDIA Vera Rubin NVL72. Gracias a un diseño conjunto de hardware y software, esta arquitectura promete ofrecer hasta diez veces menos costo de inferencia por token en comparación con generaciones anteriores, al mismo tiempo que logra un rendimiento diez veces superior en el procesamiento de tokens por megavatio.

La conexión de miles de procesadores requiere un ancho de banda masivo para evitar retrasos en el procesamiento. Las instancias A5X abordan este desafío al combinar NVIDIA ConnectX-9 SuperNICs con la tecnología de red Google Virgo. Esta configuración permite escalar hasta 80,000 GPUs NVIDIA Rubin dentro de un único clúster y hasta 960,000 GPUs en una implementación multisite. Operar a esta escala demanda una gestión de carga de trabajo sofisticada, ya que la ruta de datos a través de casi un millón de procesadores paralelos exige una sincronización precisa para evitar tiempos de inactividad en el cómputo.

Mark Lohmeyer, Vicepresidente y Gerente General de Infraestructura de IA y Computación en Google Cloud, declaró: “En Google Cloud, creemos que la próxima década de la IA será moldeada por la capacidad de los clientes para ejecutar sus cargas de trabajo más exigentes sobre una infraestructura verdaderamente integrada y optimizada para IA.”

Además de las capacidades de procesamiento, la gobernanza de datos se mantiene como un tema crucial para las implementaciones empresariales. Sectores altamente regulados, como el financiero y el de salud, a menudo frenan las iniciativas de aprendizaje automático debido a los requisitos de soberanía de datos y los riesgos de exponer información confidencial. Para abordar estos mandatos de cumplimiento, los modelos Google Gemini que funcionan con GPUs NVIDIA Blackwell y Blackwell Ultra están ingresando a una fase de vista previa en Google Distributed Cloud. Este método de implementación permite a las organizaciones mantener modelos de frontera completamente dentro de sus entornos controlados, junto con sus almacenes de datos más sensibles.

La arquitectura incorpora NVIDIA Confidential Computing, un protocolo de seguridad a nivel de hardware que garantiza que los modelos de entrenamiento operen dentro de un entorno protegido donde los datos de entrada y de ajuste permanecen encriptados. Esta encriptación impide que partes no autorizadas, incluidos los propios operadores de la infraestructura en la nube, puedan visualizar o alterar los datos subyacentes. Para entornos de nube pública multi-inquilino, una vista previa de VMs G4 Confidential equipadas con GPUs NVIDIA RTX PRO 6000 Blackwell introduce estas mismas protecciones criptográficas, brindando a las industrias reguladas acceso a hardware de alto rendimiento sin violar estándares de privacidad de datos.

La construcción de sistemas de IA agentic de múltiples pasos implica conectar modelos de lenguaje grandes a interfaces de programación de aplicaciones complejas, mantener la sincronización de bases de datos vectoriales y mitigar activamente las alucinaciones algorítmicas durante la ejecución. Para simplificar esta pesada carga de ingeniería, NVIDIA Nemotron 3 Super está ahora disponible en la plataforma Gemini Enterprise Agent. Esta plataforma proporciona a los desarrolladores herramientas para personalizar y desplegar modelos de razonamiento y multimodales específicamente diseñados para tareas agentic.

El amplio ecosistema de NVIDIA en Google Cloud está optimizado para varios modelos, incluyendo las familias Gemini y Gemma, ofreciendo a los desarrolladores las herramientas necesarias para construir sistemas que razonen, planifiquen y actúen. Entrenar estos modelos a gran escala introduce una carga operativa considerable, especialmente al gestionar el tamaño del clúster y las fallas de hardware durante largos ciclos de aprendizaje por refuerzo. Google Cloud y NVIDIA presentaron Managed Training Clusters en la plataforma Gemini Enterprise Agent, que incluye una API de aprendizaje por refuerzo gestionada construida con NVIDIA NeMo RL. Este sistema automatiza el tamaño del clúster, la recuperación de fallas y la ejecución de trabajos, permitiendo que los equipos de ciencia de datos se concentren en la calidad del modelo en lugar de la gestión de infraestructura de bajo nivel.

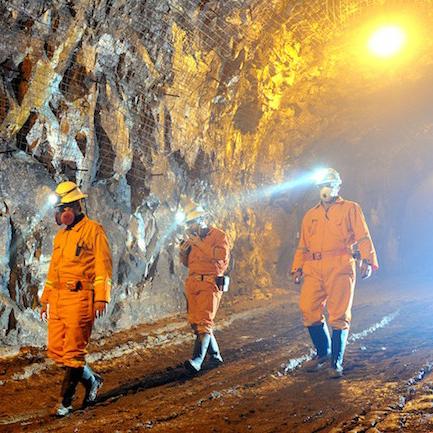

La integración del aprendizaje automático en la industria pesada y la manufactura presenta una clase diferente de desafíos de ingeniería. Conectar modelos digitales a los pisos de fábrica físicos requiere simulaciones precisas, un poder computacional masivo y estandarización entre formatos de datos heredados. Las bibliotecas de IA y de IA física de NVIDIA están ahora disponibles en Google Cloud, proporcionando la base para que las organizaciones simulen y automaticen flujos de trabajo de manufactura en el mundo real. Proveedores de software industrial importantes, como Cadence y Siemens, han puesto sus soluciones a disposición en Google Cloud, aceleradas por la infraestructura de NVIDIA.

Estas herramientas impulsan la ingeniería y manufactura de maquinaria pesada, plataformas aeroespaciales y vehículos autónomos. Muchas empresas manufactureras operan con sistemas de gestión del ciclo de vida del producto que tienen décadas, lo que dificulta la traducción de datos de geometría y física. Al utilizar las bibliotecas de NVIDIA Omniverse y el marco de simulación de robótica de código abierto NVIDIA Isaac Sim a través del Google Cloud Marketplace, los desarrolladores pueden eludir algunos de estos problemas de traducción para construir gemelos digitales físicamente precisos y entrenar tuberías de simulación robótica antes de su implementación física.